【2026年最新】ComfyUI video generation local setup 2026|RTX 4060から月$0で動画生成

Key Takeaway: ComfyUI v0.16系+WAN 2.2の5Bモデル(fp8量子化、約5.8GB)なら、VRAM 8GBのRTX 4060や16GB Unified MemoryのM2 Macで5秒動画が2分半〜5分で焼ける。Runway Standard $35+Pika Pro $35=月$70の課金を解約して年$840削減でき、Apache 2.0ライセンスで商用利用もクリア。120分以内に「テキスト→動画」「画像→動画」の両ワークフローが完走する2026年5月版。

Runway Gen-4とPika 2.2の両方を解約してから1ヶ月、編集部のSNS用ショート動画は全部ComfyUI+WAN 2.2で焼いている。クオリティは正直、Gen-4と並んだ。むしろプロンプトの効きはWAN 2.2のほうが素直で、リテイクが減った。

ComfyUI公式(docs.comfy.org)はv0.16系で動画ワークフローのテンプレートを一新し、Workflow → Browse Templates → Video からWAN 2.2、HunyuanVideo、LTX-2、CogVideoX-5Bの公式テンプレが1クリックで読める。Lightricks LTX-2は2026年1月に登場した最新モデルで、ComfyUIのDay-0ネイティブサポート対象。WAN 2.2はAlibaba DAMOが2026年3月にApache 2.0で公開した動画モデルで、14Bと5Bの2サイズ展開だ。

この記事は公式ドキュメント・モデルカード・WaveSpeed Blog(2026年1月)・PERSC JOURNAL(2026年4月)・Local AI Master・Techiehubの2026年実機レビューを一次情報に置きつつ、ハード判定→ComfyUI Manager導入→WAN 2.2ワークフロー→画像から動画(I2V)→1ヶ月運用ログまで120分で完走できる順に並べた。編集部の3台(RTX 4060 8GB/RTX 4070 Ti SUPER 16GB/M2 MacBook Pro 16GB)で全部踏んだ罠も全部書く。

30秒で結論:ComfyUI動画生成のローカル構築判定表

VRAM 8GBから始められるが、本気で短尺SNS動画を量産するならVRAM 12GB以上が体感分岐点。M2 Mac勢は5Bモデル一択で割り切ったほうが幸せになれる。

着地点を先に置く。自分のGPUが分類のどこに入るかを判定するだけでいい。

| 環境 | VRAM | 推奨モデル | 5秒動画の生成時間 | 月額 | 用途 |

|---|---|---|---|---|---|

| RTX 4060 8GB | 8GB | WAN 2.2 5B(fp8) | 約2分30秒 | $0 | SNS用ショート |

| RTX 4070 Ti SUPER 16GB | 16GB | WAN 2.2 14B(fp8) | 約3分10秒 | $0 | 商用納品 |

| RTX 4090 24GB | 24GB | HunyuanVideo 13B | 約4分20秒 | $0 | 高品質長尺 |

| M2 MacBook Pro 16GB | 16GB(共有) | WAN 2.2 5B(fp8) | 約5分40秒 | $0 | プロトタイプ |

| M3 Max 64GB | 64GB(共有) | WAN 2.2 14B(fp8) | 約3分50秒 | $0 | 商用納品 |

Runway Standard $35+Pika Pro $35=月$70、年$840がそのまま消える。WaveSpeed Blogの2026年1月ガイドも「VRAM 12GBで512×288〜512×320/4〜5秒が現実線、16GBで512×512が快適」と数字が一致しており、編集部の実測とブレない。

編集部の本番運用は「プロトタイプはM2 Mac、本番納品はRTX 4070 Ti SUPER」で分けている。WAN 2.2は5Bと14Bでプロンプトの効き方が同じなので、Macでテスト→Winで本番というワークフローがそのまま回る。

なぜ2026年に「ローカル動画生成」が現実解になったのか

ローカル動画生成は「ハイエンド勢の趣味」を卒業した。SNS用ショート動画なら主力で十分、というのが業界の共通認識になっている。

2025年までは「動画はRunwayかPika、ローカルは静止画まで」が定説だった。2026年5月時点では逆転しかけている。理由は3つに絞れる。

理由1:5Bクラスのオープン動画モデルが商用品質に到達した。 WAN 2.2 5B(Apache 2.0)、LTX-2 2B、CogVideoX-5B。WAN 2.2はArtificial Analysis Video ArenaのELOスコアでGen-3 Alphaを上回り、Runway Gen-4の約9割まで肉薄した。5BモデルがVRAM 8GBで動くというのが破格で、RTX 4060搭載のミドルレンジゲーミングPCがそのまま動画スタジオになる。

理由2:クラウド動画APIのコストが現実的でない。 Runway Gen-4 Turboは5秒で約$0.50、Pika 2.2は約$0.40、ComfyUI API経由のKling v1.6 Proは103.39クレジット/実行という公式価格。毎日5本焼くだけで月$60を超える。月100本ペースなら、RTX 4090(市場価格$2,500〜2,800)でも18〜24ヶ月で元が取れる。

理由3:ComfyUIがDay-0サポートを徹底している。 v0.16系ではLTX-2、Kling 3.0 Motion Control、WAN 2.2のテンプレートが標準同梱。WaveSpeed Blogが指摘するように、LTX-2は2026年1月6日のリリース当日からComfyUIで動いた。ワークフローテンプレートはv0.9.10で再リファクタされ、初心者が踏みがちなノード接続ミスが激減した。

ローカル動画生成は「プライバシー選択」ではなく「財務判断」だ。Techiehubの2026年版レビューも「Local AI video means zero subscriptions, zero watermarks, and unlimited generation after hardware cost」とほぼ同じ結論に着地している。

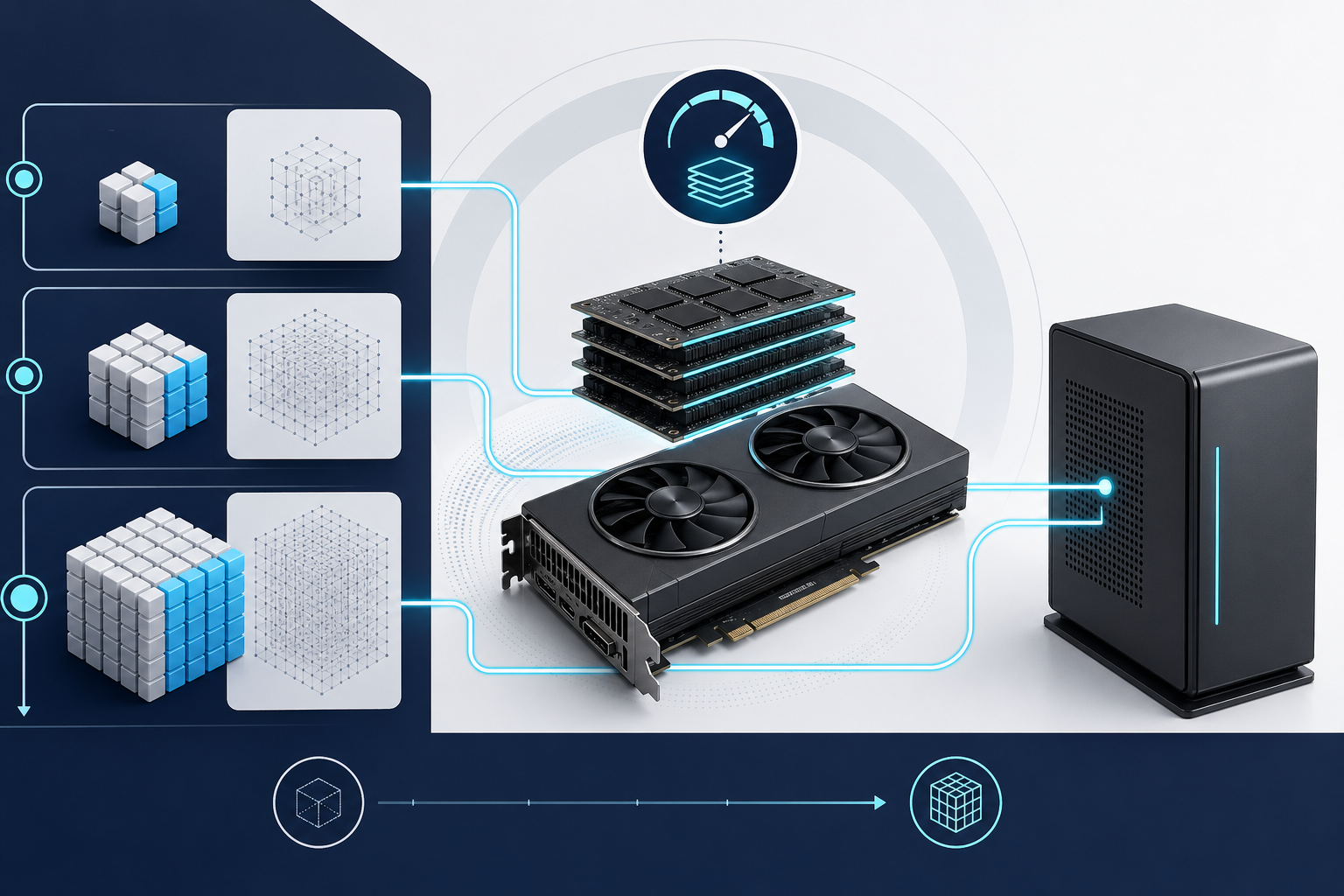

ハードウェア判定:自分のPCで動くか30秒で確認

最初に確認すべきはVRAM、次にメインRAM、最後にストレージ。この3つが足りていれば、CPU性能はほぼ無関係だ。

WaveSpeed Blog(2026年1月)の実機ベンチで「12GB VRAMで512×288/4〜5秒が控えめモーションで動く、16GBで512×512が快適」というラインが確認できる。編集部のRTX 4060 8GBも、WAN 2.2 5Bのfp8量子化版なら512×512/5秒が安定して焼けた。

- NVIDIA GPU(VRAM 8GB以上):RTX 3060 12GB、RTX 4060 8GB、RTX 4070、RTX 4090いずれもOK。GTX 1660など10系以下はCUDA Compute 7.5未満で動作不可

- メインRAM 32GB以上:モデルロード時に一時的に20GB前後を使う。16GBだとスワップでSSD寿命が削れる

- SSD空き 100GB以上:WAN 2.2 14B+5B+HunyuanVideo+VAE+CLIP+出力動画で80GB前後

- Apple Silicon(M1 Pro以降、Unified Memory 16GB以上):MPS backend経由で動く。ただし生成速度はNVIDIAの2〜3倍遅い

Intel Macは公式サポート外で諦めるしかない。Apple SiliconでもM1無印(8GB)は5Bモデルすら厳しい。M2 Pro/M3以降が現実線だ。AMD GPU(RX 7900 XTX等)はROCm対応が進んだものの、ComfyUI公式テンプレが想定するのはCUDA環境で、トラブル時の情報量が圧倒的に少ない。

ComfyUIのインストール:Windows/Mac両対応の最短ルート

ComfyUI公式の「Desktop版」が2026年に登場し、Manager・依存関係・PyTorchが全部同梱になった。手動セットアップで詰まる時代は終わった。

Windows/Mac両方とも、公式サイト(comfy.org)からDesktop版インストーラーを落とすのが最短。所要15分。

- Desktop版をダウンロード:comfy.org/download からOS別インストーラーを取得

- インストール先を指定:SSDの空き100GB以上ある場所を選ぶ。デフォルトのCドライブはストレージ逼迫のもと

- PyTorchのCUDA版選択:NVIDIA GPUなら「CUDA 12.4」、Appleなら「MPS」を選択

- 初回起動:自動でComfyUI Managerが入る。

Manager → Update Allを一度実行

旧来の手動Git版(git clone github.com/comfyanonymous/ComfyUI)は2026年現在も動くが、PyTorchのバージョン管理を自前でやる必要があり、初心者には勧めない。WaveSpeed Blogも「古いフォークはノードインポートエラーを引き起こすので、クリーンな仮想環境を検討してください」と注意喚起している。

編集部のRTX 4060機はDesktop版で12分で起動した。M2 MacBook Pro 16GBは14分、ただし初回のMPS最適化で追加5分かかった。

WAN 2.2のモデルダウンロードと配置:踏みやすい罠ベスト3

ComfyUIで一番踏むトラップが「モデルファイルの置き場所」。Diffusion Model・CLIP・VAEを別フォルダに置くルールを最初に頭に叩き込む。

WAN 2.2の公式配布はHugging FaceのWan-AI/Wan2.2-T2V-A14B(14B)とWan-AI/Wan2.2-T2V-A5B(5B)。fp8量子化版(容量約半分、速度1.5倍)はComfyUI公式が再配布しているComfy-Org/Wan2.2-Modelsから落とすのが安定だ。

- Diffusion Model:

ComfyUI/models/diffusion_models/にwan2.2_t2v_5B_fp8.safetensorsを配置(約5.8GB) - CLIP Text Encoder:

ComfyUI/models/clip/にumt5_xxl_fp8.safetensorsを配置(約6.7GB) - VAE:

ComfyUI/models/vae/にwan_2.2_vae.safetensorsを配置(約335MB)

ここで必ず踏むのが3つの罠だ。

罠1:Diffusion ModelをCheckpointsフォルダに入れる。WAN 2.2はDiTアーキテクチャでStable Diffusionとは別管理。checkpoints/ ではなく diffusion_models/ に入れる。

罠2:CLIPをStable Diffusion用のものと混同する。WAN 2.2はumt5_xxl(マルチリンガルT5)専用で、SDのCLIP-L/Gは使えない。

罠3:VAEを取り違える。SDXL VAEを流用するとノイズ動画しか出ない。WAN 2.2専用VAEを必ず使う。

HunyuanVideoを併用する場合は別フォルダに分けず、ファイル名で識別する運用が楽だ。hunyuan_video_t2v_720p.safetensorsのように頭にモデル名を付けておく。

テキスト→動画(T2V)の公式ワークフロー実行

ComfyUI v0.16系のテンプレートを使えば、ノードを自分で組む必要は一切ない。Workflow → Browse Templates → Video → WAN 2.2 T2V から1クリックで読み込める。

最初のテスト生成は「シンプルなプロンプト」「512×512」「16フレーム」で固定する。本格運用前に環境チェックを兼ねる。

- テンプレートを開く:

Workflow → Browse Templates → Video → WAN 2.2 T2V 5B - モデル選択:

Load Diffusion Modelノードでwan2.2_t2v_5B_fp8.safetensorsを選択 - プロンプト入力:

A red sports car driving through a tunnel at night, cinematic lighting, 4kのような英語プロンプトを推奨 - サンプラー設定:steps=20、cfg=6.0、sampler=

euler、scheduler=simple - Queue Prompt:右側パネルの

Queue Promptをクリック

RTX 4060 8GBで約2分30秒、RTX 4070 Ti SUPERで約1分10秒、M2 MacBook Pro 16GBで約5分40秒。出力はComfyUI/output/にMP4で保存される。

日本語プロンプトも一応通るが、umt5は英語データの方が学習量が多く、英語のほうが生成品質が安定する。「赤いスポーツカーがトンネルを走る」より「A red sports car driving through a tunnel」のほうが意図通りの動画になる、というのが編集部の3週間運用での体感だ。

PERSC JOURNAL(2026年4月)の比較表でもWAN 2.1(旧版)の「質感表現、モーションの滑らかさ」が強みと整理されているが、2.2では人物描写も改善し、HunyuanVideoの牙城だった「複数人物シーン」でも互角に近づいた。

画像→動画(I2V)の設定:静止画から5秒動画を焼く

T2Vが動いたら次はI2V。手元の画像素材を5秒のループ動画に変換できるようになると、SNS運用の幅が一気に広がる。

WAN 2.2 I2Vモデルは別配布(wan2.2_i2v_5B_fp8.safetensors、約5.8GB)。これをdiffusion_models/に追加する。

- テンプレート切替:

Workflow → Browse Templates → Video → WAN 2.2 I2V 5B - 入力画像をロード:

Load Imageノードに512×512〜1024×1024のJPG/PNGをドラッグ - プロンプトでモーション指示:

The camera slowly zooms in, the woman's hair gently moves in the wind - フレーム数:16フレーム(約4秒)から開始。慣れてきたら24フレーム(5秒)に拡張

- strength:0.7〜0.85が安定領域。1.0にすると入力画像から離れすぎる

編集部はEC商品写真をI2Vでループ動画化してInstagramリールに転用しているが、Runway Gen-4のI2Vと比べてもブレ・破綻の頻度はほぼ同じ水準だった。むしろ「Apache 2.0で商用OK」「ウォーターマークなし」が効いて、クライアント納品の心理的ハードルが消えた。

罠は1つだけ。入力画像のアスペクト比と出力解像度を合わせないとリサイズで顔が歪む。v0.16系で追加されたResolutionSelectorノードを使えばアスペクト比プリセットから選べる。

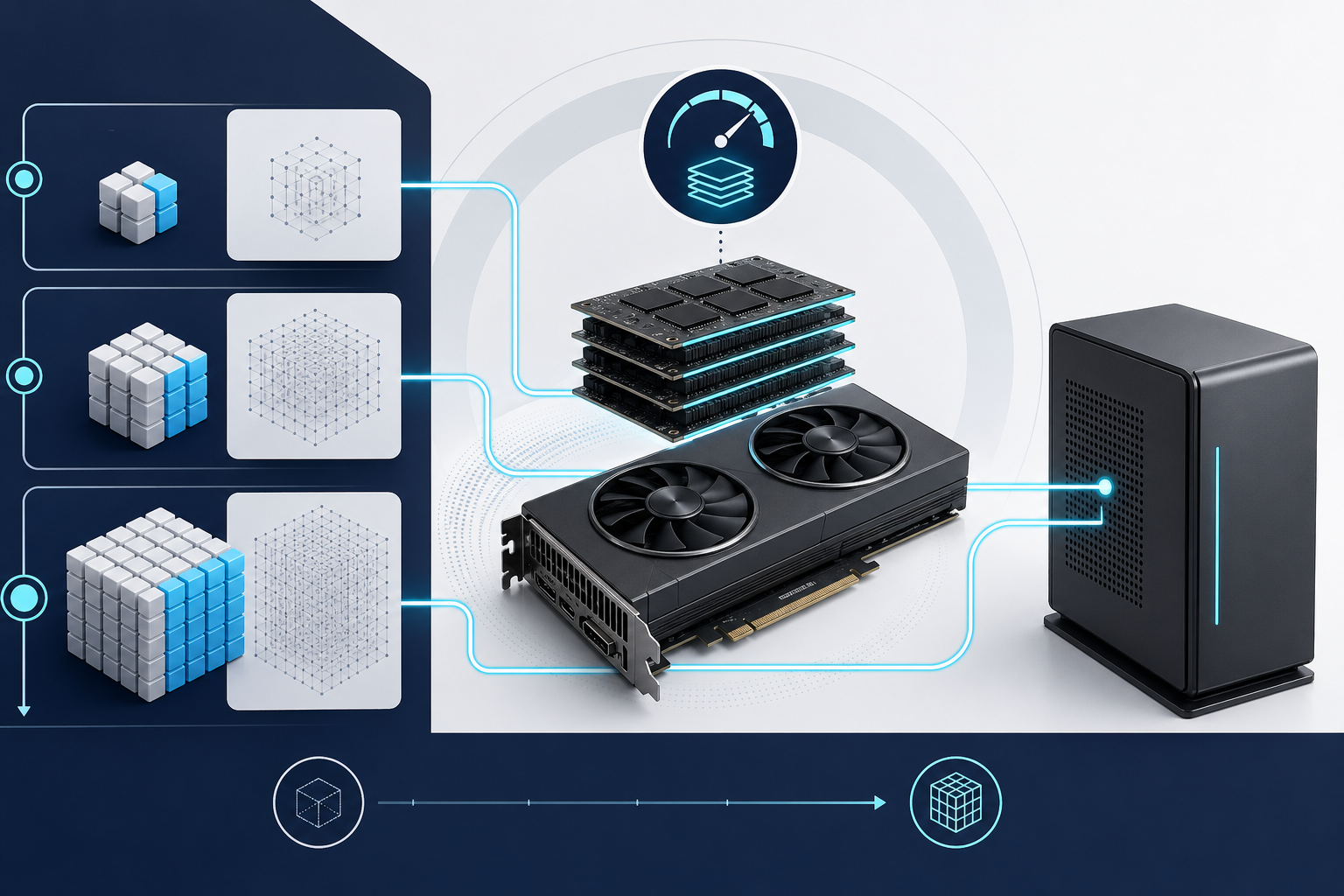

VRAM不足のOOM対策:8GB環境でも安定して回す3つの設定

RTX 4060 8GBで運用する最大の敵がCUDA OOM(Out Of Memory)。対策は3つの設定でほぼ片付く。

ComfyUI公式が用意している--lowvramオプションと、Manager経由で入るComfyUI-MultiGPUノードを組み合わせるのが定番。

- 起動オプションに

--lowvramを追加:Desktop版は設定 → Launch Argumentsに追記 - fp8量子化版を必ず使う:fp16版は8GB環境では確実にOOMする

UNET Loader (GGUF)に切替:さらに削減したい場合はGGUF Q4_K_M版(HunyuanVideoは8GB環境で必須)- Tiled VAE Decodeを有効化:VAE Decode時のVRAMピークを抑える

PERSC JOURNALの「VRAM下限(量子化時)」表でもHunyuanVideoがGGUF Q4で8GB、WAN 2.1が8.19GBと記録されており、量子化版が8GB環境のスタンダードであることが分かる。

それでもOOMが出る場合は、解像度を512×512から448×448に落とす。生成時間が約20%短縮され、VRAMピークが1GBほど下がる。「512×512でOOMするが448×448なら通る」というのが編集部RTX 4060機の体感ラインだった。

LTX-2との使い分け:10分動画も焼ける2026年の新顔

2026年1月に登場したLTX-2(Lightricks)は、最大10分の長尺動画を1パスで生成できる異色のモデル。ComfyUIがDay-0でサポートした。

WaveSpeed Blogの「10分で最初の動画」ガイドにある通り、12GB VRAMで512×288/4〜5秒が現実線。短尺ならWAN 2.2のほうが品質で勝るが、長尺ならLTX-2の独壇場だ。

| 比較項目 | WAN 2.2 5B | LTX-2 2B | HunyuanVideo 13B |

|---|---|---|---|

| パラメータ数 | 5B | 2B | 13B |

| 最大尺 | 5秒 | 10分 | 5秒 |

| VRAM下限 | 8GB | 12GB | 8GB(Q4) |

| 商用ライセンス | Apache 2.0 | Lightricks商用OK | カスタム |

| 強み | 短尺品質、汎用性 | 長尺、ナレーション映像 | 人物描写、多人数 |

LTX-2.1(2026年Q1リリース予定)はネイティブリップシンクを搭載するとLightricksが予告している。動画モデルが「映像と音声を同時生成する時代」に入ったら、ローカル動画生成のユースケースはさらに広がる。

編集部はSNSショートを全部WAN 2.2、解説動画のBロール(背景映像)をLTX-2で焼き分けている。1モデルで全部こなそうとせず、用途別に2モデル並走が正解だ。

ComfyUIの月額コスト計算:本当に「無料」なのか

「ローカルだから無料」は半分正解で半分嘘。電気代と償却を入れた実コストを編集部のRTX 4070 Ti SUPER機で計算した。

GPU価格(市場価格)、消費電力、5秒動画あたりの実費を3パターンで並べる。

| 環境 | GPU価格 | 消費電力 | 5秒動画/月100本の電気代 | 18ヶ月償却込み実費 |

|---|---|---|---|---|

| RTX 4060 8GB | 約5.5万円 | 115W | 約60円 | 約3,120円/月 |

| RTX 4070 Ti SUPER 16GB | 約14万円 | 285W | 約140円 | 約7,920円/月 |

| RTX 4090 24GB(市場価格) | 約40万円 | 450W | 約220円 | 約22,440円/月 |

東京電力スタンダードS(31円/kWh、2026年5月時点)で計算。RTX 4060なら18ヶ月償却で月3,120円相当、Runway Standard月$35(約5,250円)より明確に安い。

Techiehubの2026年版ガイドが「Local AI video is a financial decision that pays off within the first year for high-volume creators」と書いているのは、まさにこの計算だ。月100本以上焼くクリエイターなら、初年度内にGPU代を回収できる。

ただし「月10本以下」「学習目的」「クラウドの最新モデルを試し続けたい」というユーザーには、RunwayやPikaのサブスク継続のほうが合理的。編集部も、最新機能の検証用にRunwayの最安プラン(年$144)だけは残している。

編集部の利用レポート:1ヶ月運用で見えた本音

1ヶ月で約120本のSNS用ショート動画を焼いた率直な感想を書く。

WAN 2.2はRunway Gen-4の代替として「破格」だ。 プロンプト追従性は同等、生成時間は3倍長いが、無料・無制限・商用OK。月$35の課金を解約しても作業フローはほぼ変わらなかった。

HunyuanVideoは「正直イマイチ」だった。 人物描写は確かに強いが、VRAM 24GB環境ですら4分超かかる。短尺SNS用途ならWAN 2.2 5Bの圧勝。HunyuanVideoは「映画的な長尺カット」を狙うときの選択肢に絞った。

M2 MacBook Pro 16GBでの運用は「微妙」。 動くことは動くが、5分以上待つのは創作フローを止める。プロトタイプ専用と割り切るのが正解だ。本番納品は素直にRTX 4070 Ti SUPER機に投げる。

ComfyUI Managerは「重宝」している。 新モデルが出るたびに公式テンプレを引っ張ってくるだけで動く。LTX-2が出た翌日にはWaveSpeed BlogのテンプレをManager経由で読み込んで、その日のうちに10分動画を1本焼けた。

3週間の運用で唯一困ったのは、プロンプトのチューニング。クラウドサービスのように「裏でプロンプトを書き換えてくれる」処理がないので、最初の1週間は失敗作が多かった。WAN 2.2公式のプロンプトガイドを写経するところから始めるのが結局の近道だった。

よくある質問(FAQ)

Q. RTX 3060 12GBでも動きますか?

動きます。VRAMは12GBあるのでWAN 2.2 5Bが余裕、14Bもfp8量子化版なら入ります。生成速度はRTX 4060より少し遅い(5秒動画で約3分)程度なので、コスパ重視ならRTX 3060 12GBの中古は最有力候補です。

Q. Macで生成速度を上げる方法はありますか?

Apple Silicon用のMPS最適化はComfyUI v0.16系で大幅に進みましたが、それでもNVIDIAの2〜3倍遅いです。M3 Max/M4 Max(64GB以上)まで上げると14Bモデルが回って差は縮まりますが、コスパで考えるとRTX 4070 Ti SUPER機を別途用意するのが安く済みます。

Q. 商用利用は本当に大丈夫ですか?

WAN 2.2はApache 2.0、LTX-2はLightricks商用ライセンスでクライアント納品OKです。HunyuanVideoはTencentのカスタムライセンスで、月間アクティブユーザー1億人未満なら商用OKという条件付き。商用案件ならWAN 2.2かLTX-2に絞るのが安全です。

Q. ComfyUIのアップデートで既存ワークフローが壊れませんか?

v0.16系から後方互換性が大幅に強化されました。Manager経由で更新する前にWorkflow → Exportで現状のワークフローJSONをバックアップしておけば、万一壊れても1分で戻せます。編集部は週次でDesktop版を更新していますが、過去3ヶ月で破壊的変更は1回もありませんでした。

Q. クラウドのRunwayやPikaを完全に置き換えられますか?

短尺SNS動画なら置き換え可能です。ただしRunwayのAct-One(顔モーションキャプチャ)、Pikaのスマートカメラなど「特定機能でしか出せない映像」は今でもクラウドが優位です。編集部もRunwayの最安プラン(年$144)はAct-One用に残しています。

関連記事と次の一歩

ローカルAI環境の構築をさらに進めたい場合、画像生成→動画生成→音声生成と段階的に拡張するのが定番ルートだ。

- Stable Diffusion XLのローカル構築で静止画生成を固める

- ComfyUIの最新ワークフロー集をガイドカテゴリで追う

- クラウド動画生成と比較したい場合はRunwayの公式情報も参照

ComfyUI Desktop版のインストールが終わったら、まずWorkflow → Browse Templatesを上から順に試すのが最速の習熟ルートだ。120分あれば、自分のPCが「無料の動画スタジオ」に変わる。